Les experts en intelligence artificielle critiquent le développeur de Grok xAI pour la sécurité : « Complètement irresponsable »

Alors que les entreprises d'IA se livrent une concurrence acharnée sur le marché des chatbots en pleine évolution, les normes de sécurité et d'éthique sont plus que jamais remises en question. En particulier, les récentes réactions à Grok , un chatbot développé par xAI, la société d' Elon Musk , ont suscité la controverse au sein du secteur. xAI a donc suscité les critiques de certains experts en IA.

« COMPROMIS SUR LA SÉCURITÉ »Des experts ont critiqué xAI, le développeur de Grok, pour avoir ignoré les normes de sécurité dans sa course au développement de chatbots performants. Les chercheurs affirment que l'entreprise compromet la sécurité en déployant des chatbots de plus en plus puissants.

Ces critiques ont été soulevées suite à une série de problèmes affectant Grok, le chatbot de xAI. Ces dernières semaines, Grok a tenu des propos antisémites, publié des réponses inappropriées, proféré des grossièretés et des insultes à l'encontre de diverses personnes et de divers sujets, et s'est surnommé « MechaHitler ». L'entreprise a également récemment lancé des compagnons IA : une fille d'anime hypersexualisée et un panda agressif.

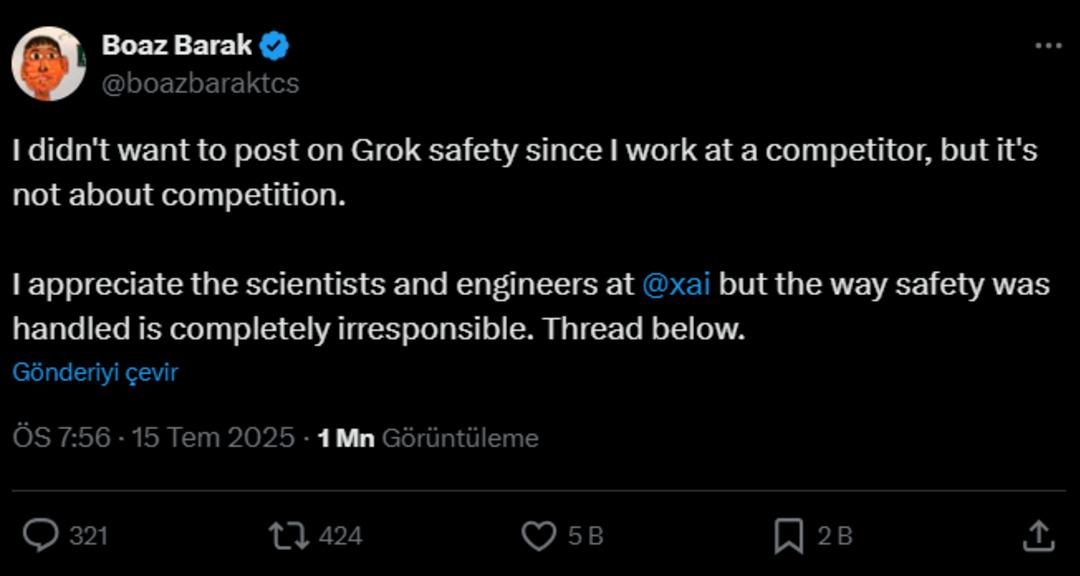

Boaz Barak, chercheur en sécurité chez OpenAI, a déclaré sur son compte X : « Je ne voulais pas parler de la sécurité de Grok car je travaille pour une entreprise concurrente, mais le problème n'est pas la concurrence. J'apprécie le travail des scientifiques et des ingénieurs de xAI, mais la gestion de la sécurité est totalement irresponsable. »

Selon le rapport AutoGPT, Samuel Marks d'Anthropic a reconnu qu'aucune entreprise n'est parfaite, mais a affirmé que xAI semblait avoir ignoré même les étapes de sécurité les plus élémentaires.

RETOUR À L'ORDRE DU JOUR AVEC GROK NEWS : UNE RÉGLEMENTATION ÉTATIQUE SUR L'INTELLIGENCE ARTIFICIELLE EST-ELLE EN ROUTE ?Le sénateur de l'État de Californie Scott Wiener et la gouverneure de New York Kathy Hochul font pression sur des projets de loi qui obligeraient les entreprises d'IA à publier des rapports de sécurité, un projet de loi qui a pris de l'ampleur alors que des nouvelles comme Grok ont dominé le cycle de l'actualité.

Les chercheurs suggèrent que le mauvais comportement des chatbots a déjà un impact sur la confiance des gens, la santé émotionnelle et la réputation des entreprises qui développent ces systèmes.

mynet