Accessibilità digitale, Apple presenta le novità 2025

Il 15 maggio è il Global Accessibility Awareness Day, giornata internazionale che si celebra ogni anno questo mese per sensibilizzare sul tema dell’accessibilità digitale. Apple ha avviato la divisione che si occupa dello sviluppo di queste soluzioni 40 anni fa. Un percoso che seguito lo sviluppo tecnologico e dei device: l’arrivo del voice over su iPhone nel 2009, gli “MFi hearing aids”. “Made for iPhone hearing aids” — cioè apparecchi acustici compatibili con iPhone nel 2014, la modalità “lettore accessibilità” per facilitare la lettura a utenti con disabilità visive o cognitive l’anno scorso e così via.

Per il 2025 ha introdotto una serie di nuove funzionalità, in arrivo entro la fine dell’anno, a partire dalle schede sull’accessibilità sull’App Store, poi la Lente per Mac, Braille Access e Accessibility Reader e altro. Per tutto maggio in alcuni Apple store ci saranno tavoli dedicati per dare risalto alle funzioni di accessibilità su vari dispositivi. Oltre alle sessioni di Today at Apple dedicata a questo per tutto l’anno.

“L’accessibilità fa parte del DNA di Apple”, ha dichiarato Tim Cook, CEO di Apple. “Creare tecnologie che funzionano per tutte le persone è una priorità per noi, e le innovazioni che renderemo disponibili quest’anno ci riempiono di orgoglio. Offriremo strumenti per aiutare le persone ad accedere a informazioni fondamentali, esplorare il mondo intorno a loro e fare tutto quello che amano”.

“In Apple, abbiamo alle spalle 40 anni di innovazioni nel campo dell’accessibilità, e ci impegniamo a spingerci sempre oltre introducendo nuove funzioni di accessibilità per tutti i nostri prodotti”, ha detto Sarah Herrlinger, Senior Director of Global Accessibility Policy and Initiatives di Apple. “Grazie alla potenza dell’ecosistema Apple, queste funzioni si integrano alla perfezione per offrire alle persone nuovi modi di interagire con le cose a cui tengono di più”.

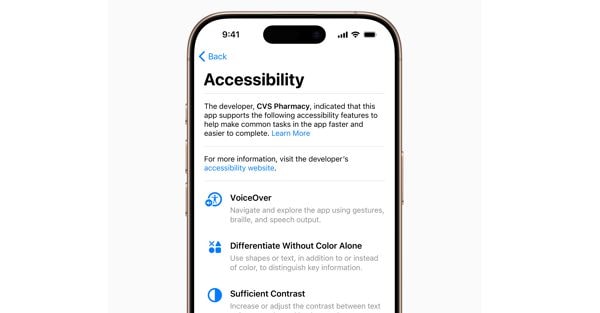

Le schede sull’accessibilità introducono una nuova sezione nelle pagine dei prodotti dell’App Store che metterà in evidenza le funzioni di accessibilità all’interno di app e giochi. Queste schede offriranno agli utenti un nuovo modo per scoprire se un’app è accessibile prima di scaricarla, dando a chi si occupa di sviluppo l’opportunità di informare e spiegare meglio alle persone le funzioni supportate dalla loro app. Queste includono VoiceOver, “Controllo vocale”, “Testo più grande”, “Contrasto sufficiente”, “Riduci movimento”, trascrizioni, e altro.

Le schede accessibilità per le app

Dal 2016, l’app Lente su iPhone e iPad offre alle persone cieche o ipovedenti strumenti per ingrandire, leggere testi e rilevare oggetti intorno a loro. Quest’anno l’app Lente arriva su Mac per rendere il mondo reale più accessibile alle persone ipovedenti. L’app Lente per Mac si connette alla fotocamera dell’utente, permettendo di ingrandire ciò che ha intorno, ad esempio, uno schermo o una lavagna. Lente funziona con la fotocamera Continuity su iPhone e con le fotocamere USB collegate, e supporta la lettura di documenti tramite Panoramica Scrivania.

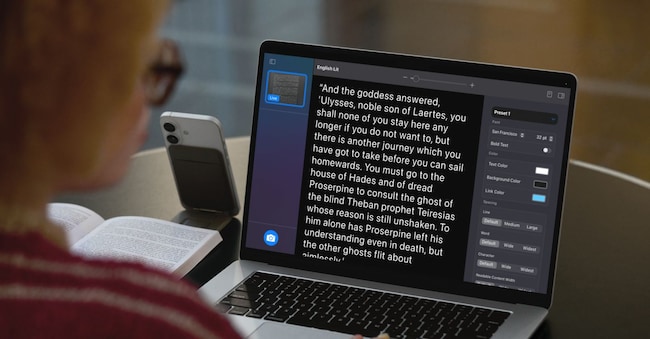

Con più finestre di sessioni live, gli utenti potranno lavorare in multitasking visualizzando una presentazione con una webcam e allo stesso tempo seguire un libro con Panoramica Scrivania. Grazie a viste personalizzate, potranno regolare la luminosità, il contrasto, i filtri colore e persino la prospettiva, per rendere testi e immagini più facili da leggere. Potranno anche acquisire, raggruppare e salvare le viste per lavorarci in un secondo momento. Inoltre, l’app Lente per Mac integra un’altra nuova funzione di accessibilità, Accessibility Reader, che trasforma il testo rilevato nel mondo reale in un formato leggibile personalizzato.

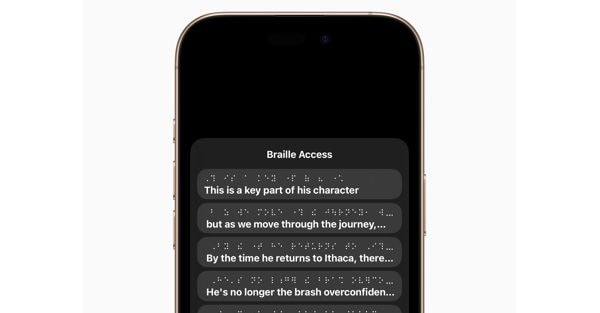

Lettura braille

Braille Access trasforma iPhone, iPad, Mac e Apple Vision Pro in strumenti completi per prendere appunti in braille, il sistema di scrittura e lettura tattile usato principalmente dalle persone non vedenti o ipovedenti. Con una funzione integrata per l’avvio delle app, gli utenti potranno aprire facilmente qualsiasi app digitando con “Input Braille schermo” o un dispositivo braille collegato. Con Braille Access, è possibile prendere appunti al volo in formato braille ed eseguire calcoli usando il codice braille di Nemeth, spesso utilizzato nelle classi per le scienze e la matematica. Gli utenti possono aprire i file Braille Ready Format (BRF) direttamente da “Braille Access”, sbloccando un’ampia gamma di libri e file creati in precedenza su dispositivi che consentono di prendere appunti in braille. E grazie a una versione integrata di “Trascrizioni live” possono trascrivere le conversazioni in tempo reale direttamente sui display braille.

Accessibility Reader è una nuova modalità di lettura, a livello di sistema, progettata per rendere più facile la lettura di testi per utenti con varie disabilità, come la dislessia o l’ipovisione. Disponibile su iPhone, iPad, Mac e Apple Vision Pro, Accessibility Reader offre alle persone nuovi modi per personalizzare i testi e concentrarsi sui contenuti che si vogliono leggere, con tante opzioni per quanto riguarda font, colore e spaziatura, nonché il supporto di “Contenuto letto ad alta voce”. La funzione Accessibility Reader si può avviare da qualsiasi app ed è integrata nell’app Lente per iOS, iPadOS e macOS, permettendo così agli utenti di interagire con il testo rilevato nel mondo reale, come libri o menu di ristoranti.

Pensati per le persone sorde o ipoudenti, i controlli di “Ascolto dal vivo” arrivano su Apple Watch con una nuova serie di funzioni, tra cui le trascrizioni live in tempo reale. “Ascolto dal vivo” trasforma iPhone in un microfono remoto per trasmettere i contenuti direttamente agli AirPods, alle cuffie Beats o ai dispositivi acustici “Made for iPhone”. Quando è attiva una sessione su iPhone, gli utenti possono visualizzare le “Trascrizioni live” dei contenuti rilevati da iPhone su un Apple Watch abbinato mentre ascoltano l’audio. Apple Watch funge da telecomando per avviare o interrompere le sessioni di “Ascolto dal vivo”, o per tornare indietro a una sessione e recuperare qualcosa che potrebbe essere andato perso. Con Apple Watch, gli utenti può controllare le sessioni di “Ascolto dal vivo” anche dall’altra parte di una stanza, senza doversi alzare nel bel mezzo di una riunione o di una lezione.

Per le persone cieche o ipovedenti, visionOS amplierà le funzioni di accessibilità per la vista usando l’evoluto sistema di fotocamere di Apple Vision Pro. Con potenti aggiornamenti alla funzione Zoom, gli utenti potranno ingrandire tutto ciò che è visibile, incluso l’ambiente intorno, usando la fotocamera principale. Per chi usa VoiceOver, la funzione “Riconoscimento in tempo reale” in visionOS utilizza il machine learning on-device per descrivere l’ambiente circostante, trovare oggetti, leggere documenti, e altro.

Notizie e approfondimenti sugli avvenimenti politici, economici e finanziari.

Iscrivitiilsole24ore