Le piattaforme meta hanno mostrato centinaia di annunci deepfake "nudify", secondo quanto scoperto da CBS News

Meta ha rimosso una serie di annunci pubblicitari che promuovevano app "nudify" ( strumenti di intelligenza artificiale utilizzati per creare deepfake sessualmente espliciti utilizzando immagini di persone reali) dopo che un'indagine della CBS News ha scoperto centinaia di annunci simili sulle sue piattaforme.

"Abbiamo regole severe contro le immagini intime non consensuali; abbiamo rimosso queste pubblicità, eliminato le pagine responsabili della loro pubblicazione e bloccato in modo permanente gli URL associati a queste app", ha dichiarato un portavoce di Meta a CBS News in una dichiarazione inviata via e-mail.

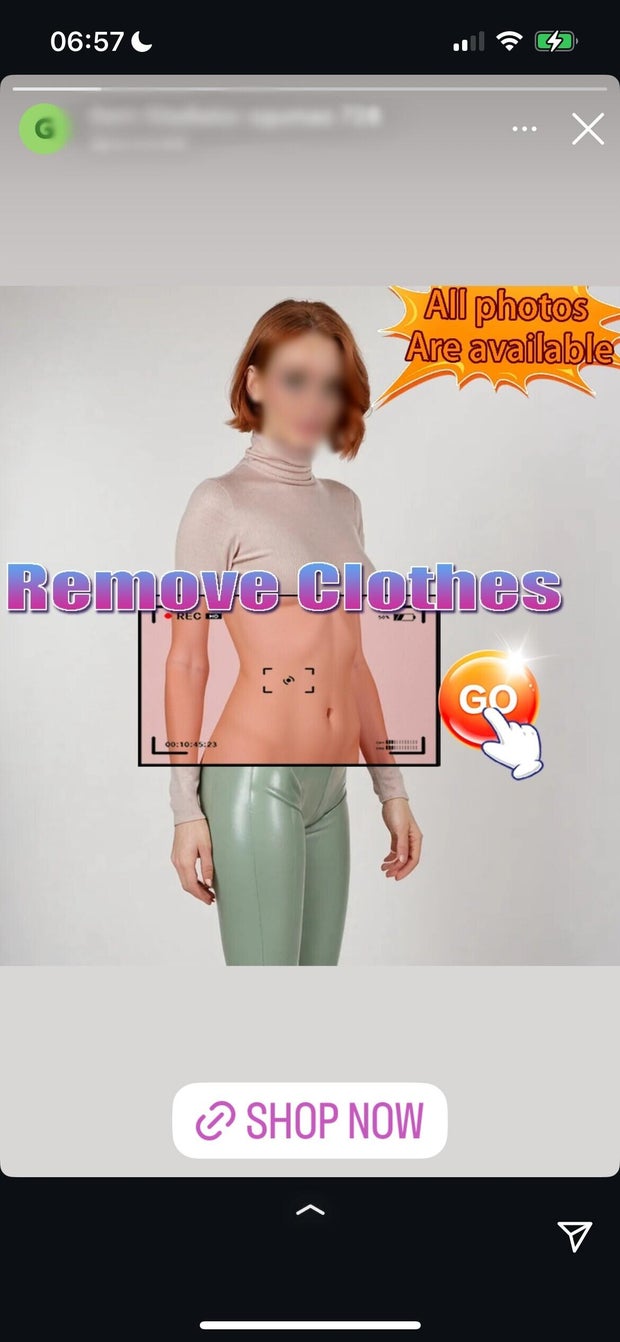

CBS News ha scoperto decine di questi annunci sulla piattaforma Instagram di Meta, nella sezione "Storie", che promuovevano strumenti di intelligenza artificiale che, in molti casi, pubblicizzavano la possibilità di "caricare una foto" e "vedere chiunque nudo". Altri annunci nelle Storie di Instagram promuovevano la possibilità di caricare e manipolare video di persone reali. In un annuncio promozionale, sotto un esempio di deepfake di nudo , si leggeva persino "Come è possibile che questo filtro sia consentito?".

Un annuncio pubblicitario promuoveva il suo prodotto di intelligenza artificiale utilizzando immagini deepfake altamente sessualizzate, in intimo, delle attrici Scarlett Johansson e Anne Hathaway. Alcuni link URL degli annunci reindirizzavano a siti web che promuovevano la possibilità di animare immagini di persone reali e indurle a compiere atti sessuali. Alcune applicazioni richiedevano agli utenti un pagamento tra i 20 e gli 80 dollari per accedere a queste funzionalità "esclusive" e "avanzate". In altri casi, l'URL di un annuncio reindirizzava gli utenti all'app store di Apple, dove erano disponibili per il download app per "nudificare".

Un'analisi degli annunci pubblicitari nella libreria di Meta ha rilevato che ce n'erano almeno centinaia disponibili sulle piattaforme social dell'azienda, tra cui Facebook, Instagram, Threads, l'applicazione Facebook Messenger e Meta Audience Network, una piattaforma che consente agli inserzionisti di Meta di raggiungere gli utenti su app mobili e siti web partner dell'azienda.

Secondo i dati della Ad Library di Meta, molti di questi annunci erano specificamente rivolti a uomini di età compresa tra 18 e 65 anni ed erano attivi negli Stati Uniti, nell'Unione Europea e nel Regno Unito.

Un portavoce di Meta ha dichiarato alla CBS News che la diffusione di questo tipo di contenuti generati dall'intelligenza artificiale è un problema continuo e che l'azienda si trova ad affrontare sfide sempre più sofisticate nel tentativo di contrastarlo.

"Le persone dietro queste app sfruttatrici sviluppano costantemente le loro tattiche per eludere il rilevamento, quindi lavoriamo costantemente per rafforzare i nostri controlli", ha affermato un portavoce di Meta.

La CBS News ha scoperto che gli annunci per gli strumenti deepfake "nudify" erano ancora disponibili sulla piattaforma Instagram dell'azienda, anche dopo che Meta aveva rimosso quelli inizialmente segnalati.

I deepfake sono immagini manipolate, registrazioni audio o video di persone reali, modificati tramite intelligenza artificiale per far credere che qualcuno abbia detto o fatto qualcosa che in realtà non ha detto o fatto.

Il mese scorso, il presidente Trump ha firmato la legge bipartisan " Take It Down Act " che, tra le altre cose, obbliga i siti web e le aziende di social media a rimuovere i contenuti deepfake entro 48 ore dalla segnalazione da parte della vittima.

Sebbene la legge renda illegale "pubblicare consapevolmente" o minacciare di pubblicare immagini intime senza il consenso di una persona, compresi i deepfake creati dall'intelligenza artificiale, la legge non prende di mira gli strumenti utilizzati per creare tali contenuti generati dall'intelligenza artificiale.

Tali strumenti violano le regole di moderazione e sicurezza della piattaforma implementate sia da Apple che da Meta sulle rispettive piattaforme.

La politica pubblicitaria di Meta stabilisce che "gli annunci non devono contenere nudità per adulti e attività sessuali. Questo include nudità, rappresentazioni di persone in posizioni esplicite o sessualmente allusive, o attività sessualmente allusive".

In base alla politica di Meta contro "bullismo e molestie", l'azienda proibisce anche "Photoshop o disegni diffamatori a sfondo sessuale" sulle sue piattaforme. L'azienda afferma che le sue normative mirano a impedire agli utenti di condividere o minacciare di condividere immagini intime non consensuali.

Le linee guida di Apple per il suo app store stabiliscono esplicitamente che sono vietati "contenuti offensivi, insensibili, sconvolgenti, volti a disgustare, di pessimo gusto o semplicemente inquietanti".

Alexios Mantzarlis, direttore della Security, Trust, and Safety Initiative presso il centro di ricerca tecnologica della Cornell University, studia da oltre un anno l'aumento del marketing basato su reti di deepfake basate sull'intelligenza artificiale sulle piattaforme social. Martedì, in un'intervista telefonica con CBS News, ha dichiarato di aver visto migliaia di altre pubblicità di questo tipo sulle piattaforme Meta, così come su piattaforme come X e Telegram, durante quel periodo.

Sebbene Telegram e X presentino quella che lui ha descritto come una "illegalità" strutturale che consente questo tipo di contenuti, ritiene che la dirigenza di Meta non abbia la volontà di affrontare il problema, nonostante la presenza di moderatori dei contenuti.

"Credo che ai team di fiducia e sicurezza di queste aziende importi. Francamente, non credo che ai vertici dell'azienda, nel caso di Meta, importi", ha affermato. "Stanno chiaramente assegnando risorse insufficienti ai team che devono combattere questa situazione, perché per quanto sofisticate siano queste reti [deepfake]... non hanno i soldi di Meta da investire."

Mantzarlis ha anche affermato di aver scoperto, durante la sua ricerca, che i generatori di deepfake "nudify" sono disponibili per il download sia sull'App Store di Apple che sul Play Store di Google, esprimendo frustrazione per l'incapacità di queste grandi piattaforme di imporre tali contenuti.

"Il problema con le app è che hanno questa facciata a doppio uso: si presentano sull'App Store come un modo divertente per scambiarsi le foto, ma poi su Meta pubblicizzano il loro scopo principale come la nudizzazione. Quindi, quando queste app vengono sottoposte a revisione su Apple o Google Store, non hanno necessariamente i mezzi per vietarle", ha affermato.

"È necessaria una cooperazione intersettoriale, per cui se un'app o un sito web si pubblicizza come uno strumento per la nudità in qualsiasi punto del web, tutti gli altri possono dire: 'Va bene, non mi interessa come ti presenti sulla mia piattaforma, sei fuori'", ha aggiunto Mantzarlis.

CBS News ha contattato sia Apple che Google per un commento sulle modalità di moderazione delle rispettive piattaforme. Nessuna delle due aziende ha ancora risposto al momento della stesura di questo articolo.

La promozione di tali app da parte di importanti aziende tecnologiche solleva seri interrogativi sia sul consenso degli utenti che sulla sicurezza online dei minori. Un'analisi di CBS News su un sito web di "nudify" promosso su Instagram ha mostrato che il sito non richiedeva alcuna forma di verifica dell'età prima che l'utente caricasse una foto per generare un'immagine deepfake.

Problemi di questo tipo sono diffusi. A dicembre, il programma 60 Minutes della CBS News ha denunciato la mancanza di verifica dell'età su uno dei siti più popolari che utilizza l'intelligenza artificiale per generare false foto di nudo di persone reali.

Nonostante ai visitatori sia stato detto che dovevano avere almeno 18 anni per utilizzare il sito e che "il trattamento dei dati dei minori è impossibile", 60 Minutes è riuscita immediatamente ad accedere al caricamento delle foto non appena l'utente ha cliccato su "accetta" nel messaggio di avviso sull'età, senza che fosse necessaria alcuna ulteriore verifica dell'età.

I dati mostrano anche che un'alta percentuale di adolescenti minorenni ha interagito con contenuti deepfake. Uno studio del marzo 2025 condotto dall'organizzazione no-profit per la tutela dei minori Thorn ha mostrato che tra gli adolescenti, il 41% ha dichiarato di aver sentito parlare del termine "nudi deepfake", mentre il 10% ha riferito di conoscere personalmente qualcuno a cui erano state create immagini di nudo deepfake.

Emmet Lyons è redattore capo presso la redazione londinese di CBS News, dove coordina e produce articoli per tutte le piattaforme CBS News. Prima di entrare in CBS News, Emmet ha lavorato come produttore alla CNN per quattro anni.

Cbs News